Wichtige Begriffe

- KI-System

- Maschinengestütztes System, das für einen gewissen Grad an Autonomie ausgelegt ist und aus Eingaben ableitet, wie Ausgaben erzeugt werden, die physische oder virtuelle Umgebungen beeinflussen können [Art. 3 Nr. 1].

- Anbieter

- Natürliche oder juristische Person, Behörde oder sonstige Stelle, die ein KI-System oder ein GPAI-Modell entwickelt oder entwickeln lässt und es unter eigenem Namen oder eigener Marke in Verkehr bringt oder in Betrieb nimmt [Art. 3 Nr. 3].

- Betreiber

- Natürliche oder juristische Person, die ein KI-System in eigener Verantwortung verwendet, ausgenommen im Rahmen einer rein persönlichen, nicht beruflichen Tätigkeit [Art. 3 Nr. 4].

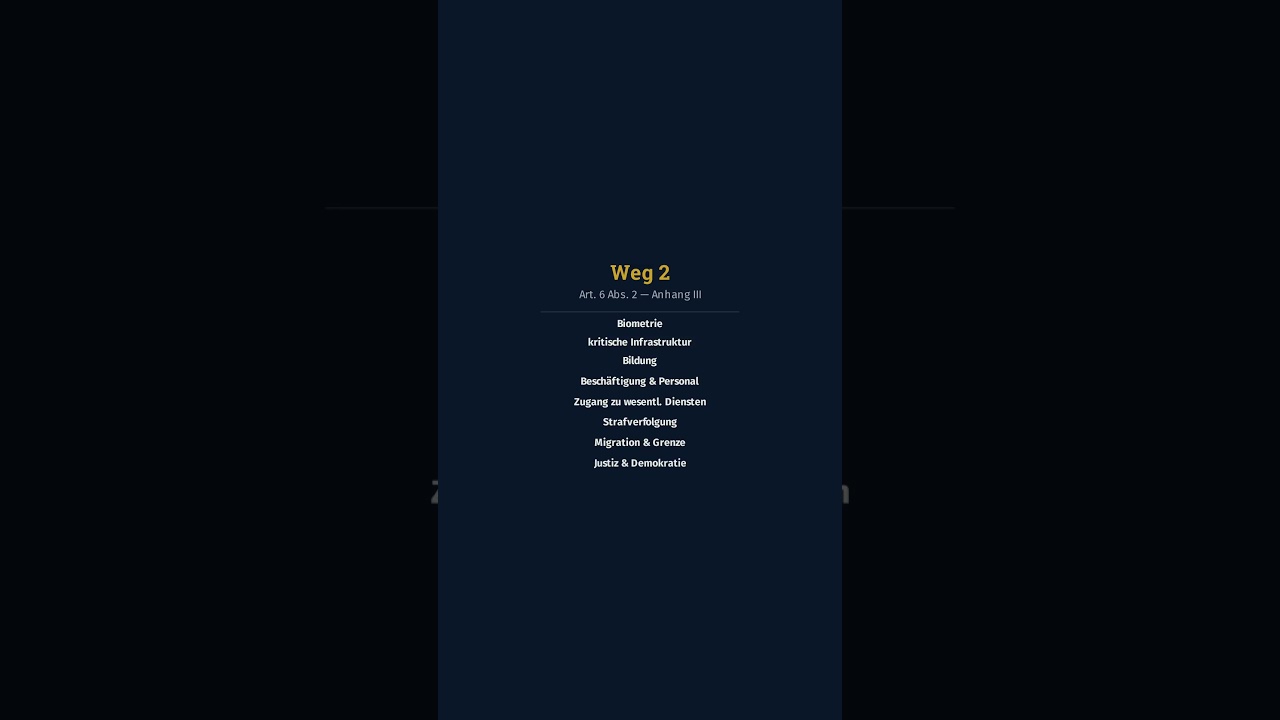

- Hochrisiko-KI-System

- KI-System, das entweder als Sicherheitsbauteil eines regulierten Produkts einer Konformitätsbewertung durch Dritte unterliegt (Art. 6 Abs. 1) oder in einem der in Anhang III genannten kritischen Bereiche eingesetzt wird und ein erhebliches Risiko birgt [Art. 6 Abs. 2].

- KI-Modell mit allgemeinem Verwendungszweck (GPAI-Modell)

- KI-Modell mit erheblicher allgemeiner Verwendbarkeit, das ein breites Spektrum unterschiedlicher Aufgaben kompetent erfüllen und in eine Vielzahl nachgelagerter Systeme integriert werden kann [Art. 3 Nr. 63].

- Konformitätsbewertung

- Verfahren zum Nachweis, dass ein Hochrisiko-KI-System die Anforderungen des Kapitels III Abschnitt 2 erfüllt — durchzuführen vor Inverkehrbringen, entweder als interne Kontrolle oder durch eine notifizierte Stelle [Art. 43].

- Systemisches Risiko

- Risiko, das spezifisch für GPAI-Modelle mit Fähigkeiten hoher Wirkkraft ist und aufgrund der Reichweite oder vorhersehbarer negativer Folgen erhebliche Auswirkungen auf den Unionsmarkt haben kann [Art. 3 Nr. 65].

Häufige Fragen

Was ist ein KI-System im Sinne des AI Act?

Wann gilt ein KI-System als hochriskant?

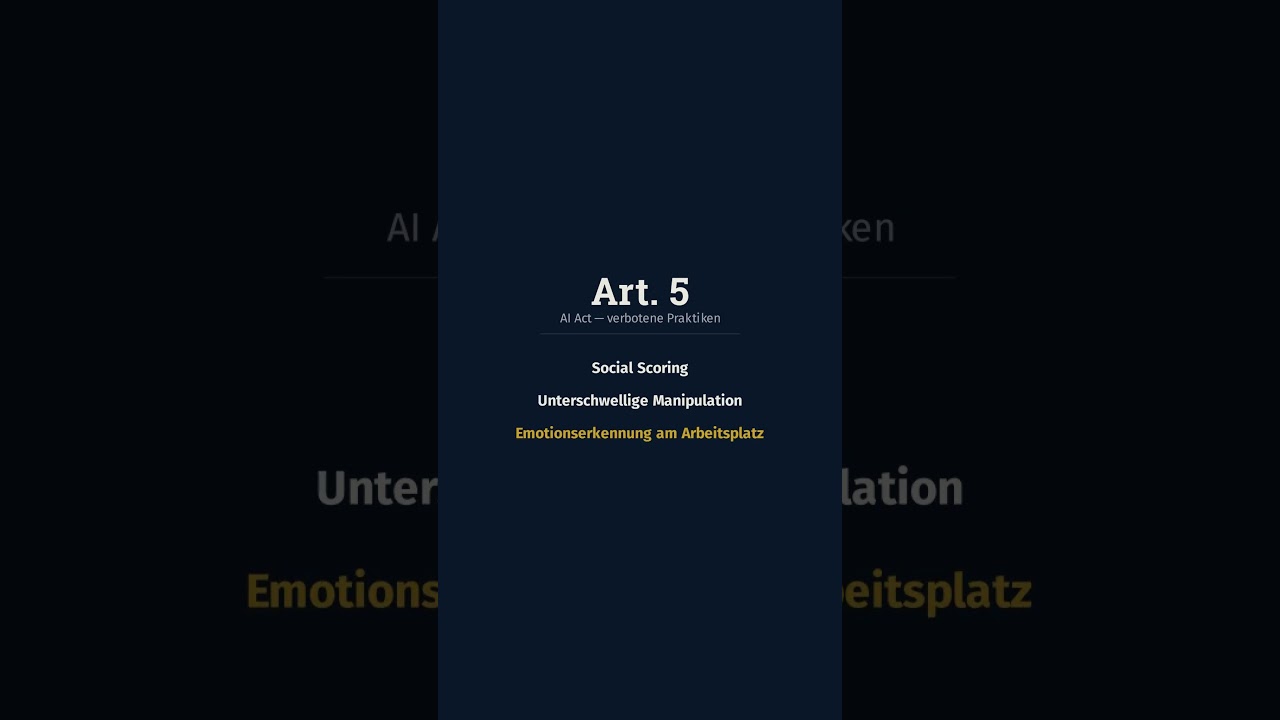

Welche KI-Praktiken sind vollständig verboten?

Sind Open-Source-KI-Modelle von der Verordnung ausgenommen?

Welche Transparenzpflichten gelten für Chatbots und Deepfakes?

Was passiert bei wesentlicher Veränderung eines Hochrisiko-KI-Systems?

Was sind KI-Modelle mit allgemeinem Verwendungszweck (GPAI) und welche Pflichten gelten?

Werkzeuge & Vorlagen

KI-generierte Compliance-Hilfen

1. Gap-Analyse Checkliste

Wurde geprüft, ob die von uns entwickelten, in Verkehr gebrachten oder genutzten KI-Systeme unter die verbotenen Praktiken gemäß Art. 5 fallen?

Haben wir einen Prozess zur Klassifizierung unserer KI-Systeme etabliert, um festzustellen, ob sie als 'Hochrisiko-KI-Systeme' gemäß Art. 6 gelten?

Wurde für jedes Hochrisiko-KI-System ein Risikomanagementsystem gemäß Art. 9 eingerichtet, dokumentiert und aufrechterhalten?

2. SOP-Vorlagen

SOP: Erstellung und Pflege der Technischen Dokumentation für Hochrisiko-KI-SystemeArt. 11, Art. 18, Anhang IV

Zweck: Diese SOP stellt sicher, dass für jedes Hochrisiko-KI-System eine konforme, vollständige und aktuelle technische Dokumentation erstellt und für den gesetzlich vorgeschriebenen Zeitraum aufbewahrt wird, um die Konformität mit dem EU AI Act nachzuweisen.

Geltungsbereich: Diese SOP gilt für alle als 'hochriskant' eingestuften KI-Systeme, die von [Name des Unternehmens] entwickelt oder in Verkehr gebracht werden.

- 1

Identifizierung eines KI-Systems als Hochrisiko-KI-System gemäß Klassifizierungsprozess (siehe Entscheidungsbaum).

Verantwortlich: Produktmanagement / Compliance Officer | Output: Dokumentierte Klassifizierung des KI-Systems als 'Hochrisiko'.

- 2

Anlegen einer neuen Struktur für die technische Dokumentation basierend auf Anhang IV.

Verantwortlich: Leiter des Entwicklungsteams / Technischer Redakteur | Output: Leere, strukturierte Vorlage für die technische Dokumentation im Dokumentenmanagementsystem.

- 3

Zusammentragen und Einfügen aller erforderlichen Informationen gemäß Anhang IV, u.a.: Allgemeine Beschreibung, Methoden der Entwicklung, Daten-Governance, Risikomanagement-Dokumentation, Testberichte, Betriebsanleitung, Plan zur Beobachtung nach dem Inverkehrbringen.

Verantwortlich: Entwicklungsteam, Data Scientists, Produktmanagement, Technischer Redakteur, Compliance Officer | Output: Ausgefüllter Entwurf der technischen Dokumentation.

- 4

Formale Überprüfung der Vollständigkeit und Korrektheit der technischen Dokumentation.

Verantwortlich: Compliance Officer / Qualitätsmanagement | Output: Freigabeprotokoll für die technische Dokumentation.

- 5

Archivierung der finalen Version der technischen Dokumentation vor dem Inverkehrbringen. Sicherstellung der Verfügbarkeit für Behörden.

Verantwortlich: IT / Dokumentenmanagement | Output: Archivierte, versionierte technische Dokumentation.

- 6

Einrichtung eines Prozesses zur Aktualisierung der technischen Dokumentation bei jeder wesentlichen Änderung des KI-Systems oder bei neuen Erkenntnissen aus dem Post-Market-Monitoring.

Verantwortlich: Produktmanagement / Compliance Officer | Output: Definierter und dokumentierter Aktualisierungsprozess.

- 7

Sicherstellung der Aufbewahrung der Dokumentation für 10 Jahre nach dem letzten Inverkehrbringen des Systems.

Verantwortlich: IT / Rechtsabteilung | Output: Konfigurierte Aufbewahrungsrichtlinie im Archivsystem.

Prüffrequenz: Jährlich sowie bei jeder wesentlichen Änderung des KI-Systems.

3. Textbausteine

Musterklausel für Lieferantenverträge (Komponenten für Hochrisiko-KI-Systeme)Art. 25 Abs. 4

Anwendungsfall: Zur Aufnahme in Verträge mit Lieferanten von KI-Systemen, Instrumenten, Diensten, Komponenten oder Verfahren, die in ein Hochrisiko-KI-System integriert werden sollen.

Platzhalter: [Name des Lieferanten], [genaue Bezeichnung der Komponente/des Dienstes], [Name des Anbieters des Hochrisiko-KI-Systems]

+10 Gap-Checks, 1 SOPs, 2 Vorlagen warten auf Sie

Kostenlos prüfenKI-generierte Compliance-Hilfen. Keine Rechtsberatung. Bitte mit Rechtsabteilung abstimmen.

Prüfungsfaktoren & Checkliste

PremiumFragen für Ihren Anwalt

PremiumFazit & Zusammenfassung

PremiumDetaillierte Analyse mit Quellenlinks.

Schalten Sie die KI-Analyse frei — mit markierten Fundstellen und direkten Links zu EUR-Lex. Kostenlos prüfen mit Scout.

Keine Kreditkarte. 50 Recherchen + 5 KI-Analysen frei.

Kurz erklärt — Videos zum Thema

60-Sekunden-Erklärungen aus unserem YouTube-Kanal. Klick öffnet YouTube in einem neuen Tab — kein YouTube-Embed, kein Tracking auf dieser Seite.

0:58

0:58KI-Risikomanagement-Tool gekauft — reicht das für Art. 9 AI Act?

Öffnet YouTube 0:45

0:45AI Act: Warum Art. 17 ein Organisations- statt Technikgesetz ist

Öffnet YouTube 0:49

0:49Hochrisiko-System nach AI Act: Was Art. 6 Abs. 1 und 2 wirklich sagt

Öffnet YouTube 0:46

0:46Copilot im Einsatz: Wer trägt die AI-Act-Pflicht?

Öffnet YouTube 0:47

0:47Verbot oder Hochrisiko: Was den Unterschied ausmacht (Art. 5/6 AI Act)

Öffnet YouTube 1:00

1:00Wir entwickeln keine KI — gilt der AI Act trotzdem? (Art. 3)

Öffnet YouTube 1:00

1:00Nur intern, nicht zum Verkauf: Fällt der HR-Bot unter den AI Act?

Öffnet YouTube 0:53

0:53KI im Einsatz: Warum Governance Chefsache ist (AI Act)

Öffnet YouTube 1:00

1:00ChatGPT-Bot im Vertrieb: Wann gilt das schon als KI-System? (Art. 3)

Öffnet YouTube 1:00

1:00Wer haftet beim KI-Einsatz im Unternehmen? (Art. 26 AI Act)

Öffnet YouTube 0:44

0:44ChatGPT, Copilot, HR-Bot: Welche AI-Act-Stufe gilt? (Art. 5/6/50)

Öffnet YouTube 1:00

1:00Anhang III AI Act: Ist mein KI-System Hochrisiko? (Art. 6)

Öffnet YouTube