Termes clés

- Système d'IA

- Système automatisé conçu pour fonctionner à différents niveaux d'autonomie et capable de générer des sorties (prédictions, recommandations, décisions) influençant des environnements physiques ou virtuels [Art. 3 par. 1].

- Fournisseur

- Personne physique ou morale qui développe ou fait développer un système d'IA ou un modèle d'IA à usage général et le met sur le marché ou en service sous son propre nom, à titre onéreux ou gratuit [Art. 3 par. 3].

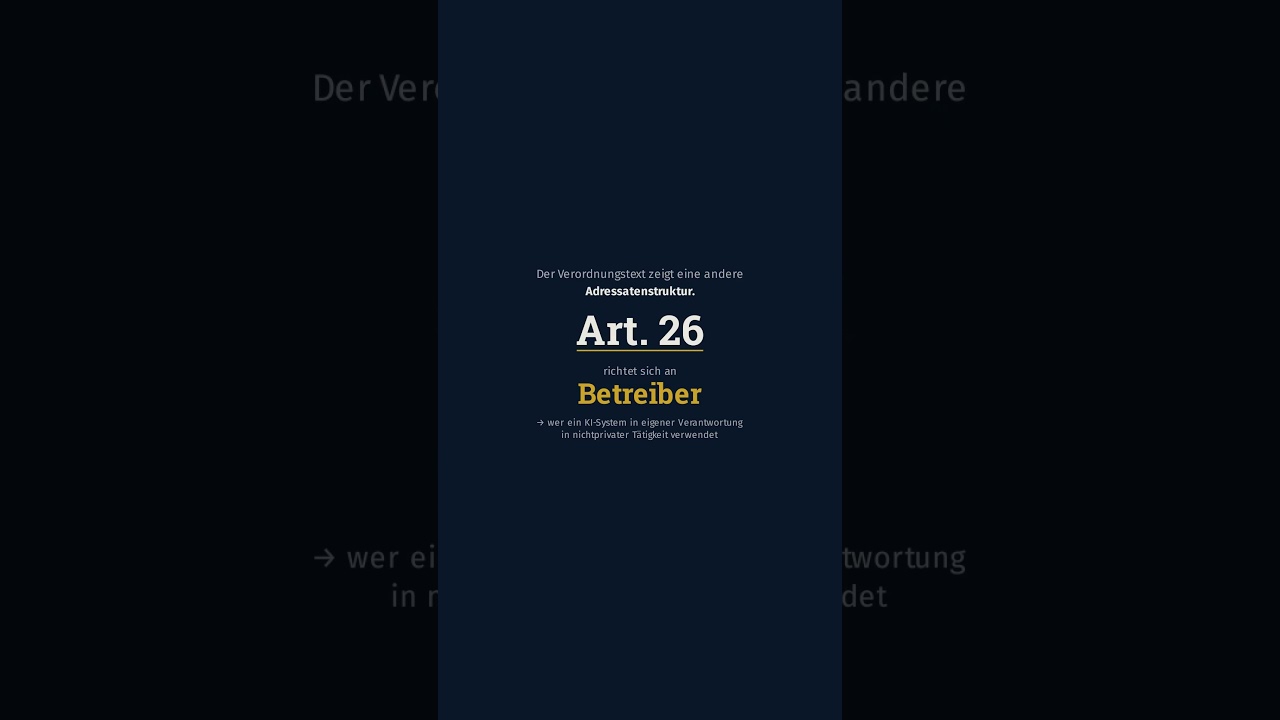

- Déployeur

- Personne physique ou morale, autorité publique ou autre organisme utilisant un système d'IA sous sa propre autorité, hors activité personnelle non professionnelle [Art. 3 par. 4].

- Système d'IA à haut risque

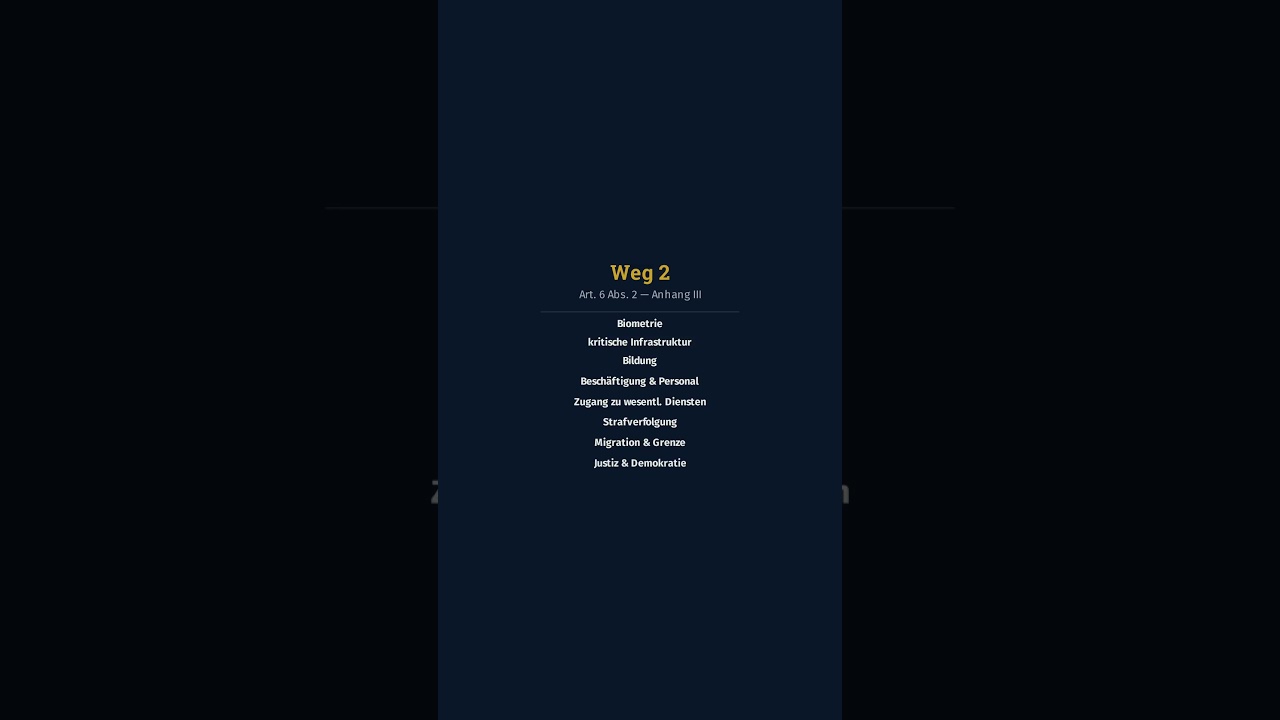

- Système d'IA classé comme tel soit parce qu'il constitue un composant de sécurité d'un produit soumis à évaluation de conformité (art. 6 par. 1), soit parce qu'il relève d'un cas d'utilisation listé à l'annexe III (art. 6 par. 2).

- Modèle d'IA à usage général

- Modèle d'IA présentant une généralité significative, capable d'exécuter un large éventail de tâches et pouvant être intégré dans divers systèmes en aval, y compris ceux entraînés par auto-supervision à grande échelle [Art. 3 par. 63].

- Risque systémique

- Risque spécifique aux modèles d'IA à usage général à fort impact, susceptible de se propager à grande échelle dans la chaîne de valeur et d'avoir des effets significatifs sur la santé publique, la sécurité ou les droits fondamentaux [Art. 3 par. 65].

- Évaluation de la conformité

- Procédure permettant de démontrer que les exigences applicables à un système d'IA à haut risque (chapitre III, section 2) ont été respectées, réalisée en interne ou par un organisme notifié tiers [Art. 3 par. 20, Art. 43].

- Hypertrucage (deepfake)

- Image, audio ou vidéo généré ou manipulé par l'IA, présentant une ressemblance avec des personnes ou événements existants et pouvant être perçu à tort comme authentique [Art. 3 par. 60].

Questions fréquentes

Quand le règlement sur l'IA est-il pleinement applicable ?

Qu'est-ce qu'un système d'IA a haut risque au sens du règlement ?

Les PME et jeunes pousses bénéficient-elles d'allégements ?

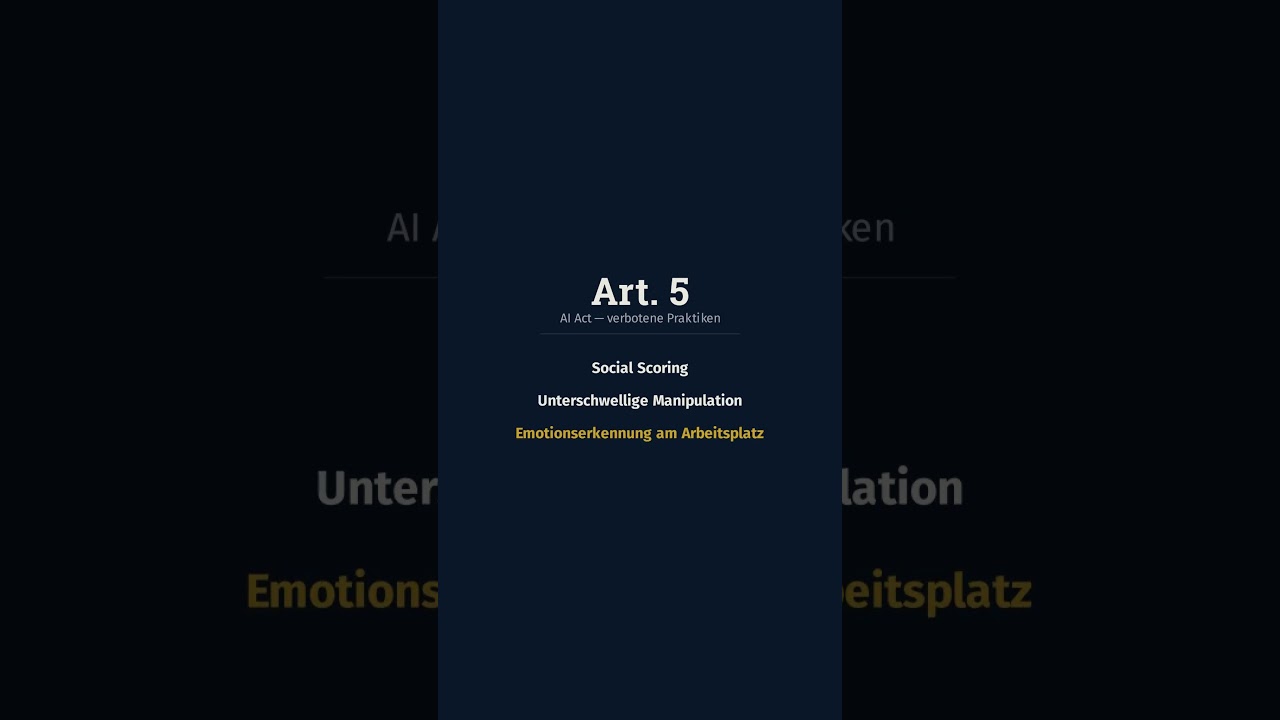

Quelles pratiques d'IA sont interdites ?

Qu'est-ce qu'un modèle d'IA à usage général (GPAI) et quelles obligations s'y appliquent ?

Comment fonctionne l'évaluation de conformité pour les systèmes à haut risque ?

Existe-t-il un droit des personnes affectées par un système d'IA ?

Facteurs d’évaluation et liste de contrôle

PremiumQuestions pour votre avocat

PremiumConclusion et résumé

PremiumAnalyse détaillée avec liens sources.

Schalten Sie die KI-Analyse frei — mit markierten Fundstellen und direkten Links zu EUR-Lex. Kostenlos prüfen mit Scout.

Keine Kreditkarte. 50 Recherchen + 5 KI-Analysen frei.

Bref — vidéos sur ce sujet

Explications de 60 secondes depuis notre chaîne YouTube. Le clic ouvre YouTube dans un nouvel onglet — aucune intégration YouTube, aucun traçage sur cette page.

0:58

0:58KI-Risikomanagement-Tool gekauft — reicht das für Art. 9 AI Act?

Ouvre YouTube 0:45

0:45AI Act: Warum Art. 17 ein Organisations- statt Technikgesetz ist

Ouvre YouTube 0:49

0:49Hochrisiko-System nach AI Act: Was Art. 6 Abs. 1 und 2 wirklich sagt

Ouvre YouTube 0:46

0:46Copilot im Einsatz: Wer trägt die AI-Act-Pflicht?

Ouvre YouTube 0:47

0:47Verbot oder Hochrisiko: Was den Unterschied ausmacht (Art. 5/6 AI Act)

Ouvre YouTube 1:00

1:00Wir entwickeln keine KI — gilt der AI Act trotzdem? (Art. 3)

Ouvre YouTube 1:00

1:00Nur intern, nicht zum Verkauf: Fällt der HR-Bot unter den AI Act?

Ouvre YouTube 0:53

0:53KI im Einsatz: Warum Governance Chefsache ist (AI Act)

Ouvre YouTube 1:00

1:00ChatGPT-Bot im Vertrieb: Wann gilt das schon als KI-System? (Art. 3)

Ouvre YouTube 1:00

1:00Wer haftet beim KI-Einsatz im Unternehmen? (Art. 26 AI Act)

Ouvre YouTube 0:44

0:44ChatGPT, Copilot, HR-Bot: Welche AI-Act-Stufe gilt? (Art. 5/6/50)

Ouvre YouTube 1:00

1:00Anhang III AI Act: Ist mein KI-System Hochrisiko? (Art. 6)

Ouvre YouTube